Contenido

- ¿Por qué la IA parece más confiable este año?

- ¿La IA razona de verdad o solo reconoce patrones?

- ¿Qué cambió en la práctica para que falle menos?

- ¿Entonces la IA necesita supervisión humana y software clásico?

- ¿Puede una empresa reemplazar empleados solo con un chatbot?

- ¿Cómo conviene usar la IA sin caer en el hype?

- Consulta dudas con nuestro Asistente IA

La inteligencia artificial parece más segura y útil que hace un año. Pero hay un detalle importante: no mejoró porque ahora “piense” como una persona.

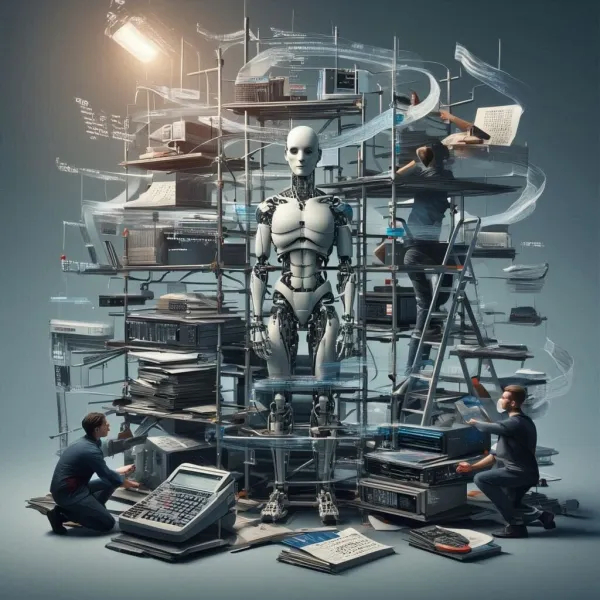

Mejoró porque aprendió a apoyarse en herramientas externas, controles y sistemas clásicos de software. Dicho sin maquillaje: la IA no se volvió una genia de la noche a la mañana; se volvió más prudente. Y eso, en psicología y en tecnología, suele dar mejores resultados que la soberbia 😉

Esta diferencia importa mucho si usas IA para estudiar, trabajar, investigar o tomar decisiones. También importa si en tu empresa alguien repite que “ya puede reemplazar a todo el mundo”. No tan rápido.

¿Por qué la IA parece más confiable este año?

La mejora no vino de un salto mágico hacia una inteligencia superior. Vino de una decisión más terrenal: dejar de confiar ciegamente en el modelo y rodearlo de ayudas.

Un caso muy citado lo mostró con claridad. En pruebas de cálculo médico, un modelo de IA cometía errores con demasiada frecuencia. Cuando los investigadores le sumaron una calculadora médica específica, la precisión se disparó. Es decir, el modelo no resolvió mejor por sí solo: resolvió mejor porque delegó.

Eso resume el cambio de época. Los sistemas actuales funcionan mejor porque combinan varias capas:

- Modelos de lenguaje para redactar y organizar respuestas.

- Herramientas externas para calcular, buscar o verificar datos.

- Controles adicionales para revisar errores antes de mostrar el resultado.

En consulta he visto algo parecido con personas muy brillantes que se exigen recordar todo. Cuando por fin usan agenda, checklist o calculadora, no se vuelven menos inteligentes: se vuelven más fiables. Con la IA pasa algo parecido.

¿La IA razona de verdad o solo reconoce patrones?

Aquí está el punto incómodo. Los modelos de lenguaje son extraordinarios detectando patrones en enormes cantidades de texto. Pero eso no significa que razonen como tú.

Diversos experimentos mostraron que, al cambiar apenas los números de un problema matemático o agregar una frase irrelevante, el rendimiento de muchos modelos cae bastante. Si el razonamiento fuera genuino, esos cambios menores no deberían desorientarlos tanto.

La conclusión es clara: la IA no entiende el mundo como una mente humana. Predice qué secuencia de palabras tiene más probabilidad de venir después según su entrenamiento.

Eso no la vuelve inútil. La vuelve distinta. Y cuando entiendes esa diferencia, la usas mejor.

La IA actual impresiona por su fluidez, no por una comprensión profunda comparable a la humana.

Este matiz suele perderse en el entusiasmo comercial. Como periodista, lo veo seguido: se vende “razonamiento avanzado” cuando muchas veces lo que hay es una muy buena orquestación de recursos.

¿Qué cambió en la práctica para que falle menos?

Hay tres mejoras concretas detrás de esta nueva confiabilidad.

- Más conocimiento especializado. Los modelos se ajustan con información preparada por expertos humanos, no solo con texto masivo de internet.

- Uso de herramientas externas. Si hay que calcular, llaman a una calculadora o a Python. Si necesitan datos recientes, consultan buscadores o bases actualizadas.

- Verificación entre sistemas. En tareas complejas, otro modelo o una capa adicional revisa la respuesta antes de entregarla.

Esto es menos glamoroso que hablar de superinteligencia, pero mucho más útil. La industria empezó a aceptar algo básico: el modelo solo no alcanza.

Y, curiosamente, cuanto más valiosa se vuelve la IA, menos trabaja sola.

¿Entonces la IA necesita supervisión humana y software clásico?

Sí. Y probablemente durante bastante tiempo.

De hecho, una de las revelaciones más interesantes de los últimos meses fue ver que algunos sistemas comerciales incluyen instrucciones explícitas para que el propio modelo desconfíe de su memoria y verifique información antes de responder.

Eso dice mucho. Los ingenieros que construyen estas herramientas no apuestan todo a que el modelo recuerde bien. Prefieren que consulte, confirme y contraste.

Suena poco épico, pero es exactamente lo que hace funcionar a los sistemas serios.

En charlas sobre tecnología suelo repetir una idea que al principio decepciona y luego tranquiliza: la IA más útil no es la que promete hacerlo todo sola, sino la que sabe cuándo pedir ayuda.

Eso también explica por qué el software tradicional sigue siendo clave. Bases de datos, motores de búsqueda, reglas, validaciones, memorias estructuradas y código determinista siguen haciendo el trabajo pesado detrás del telón.

¿Puede una empresa reemplazar empleados solo con un chatbot?

En la mayoría de los casos, no. O no de la manera simple que algunos imaginan.

Si una organización cree que basta con pagar una suscripción mensual para sustituir equipos enteros, probablemente está comprando una fantasía elegante. Lo que realmente funciona es una arquitectura más compleja:

- Integraciones con sistemas internos.

- Herramientas de validación.

- Supervisión humana.

- Diseño de flujos de trabajo.

- Profesionales capaces de detectar errores y corregir sesgos.

La paradoja es esta: cuanto más útil quieres que sea la IA, más necesitas personas competentes alrededor.

No menos talento. Más talento, pero mejor distribuido.

Esto no significa que nada vaya a cambiar. Claro que cambiará. Algunas tareas repetitivas se automatizarán más. Algunos puestos se rediseñarán. Pero pensar que un chatbot reemplaza sin más el criterio, la experiencia y la responsabilidad humana es una simplificación peligrosa.

¿Cómo conviene usar la IA sin caer en el hype?

La mejor estrategia es verla como una herramienta poderosa, no como un oráculo.

Si quieres sacarle provecho de verdad, te conviene seguir estas reglas:

- Úsala para acelerar borradores, resumir, ordenar ideas y explorar opciones.

- Verifica datos, cifras, citas y fechas importantes.

- No delegues decisiones sensibles sin revisión humana.

- Si la tarea requiere precisión, combínala con herramientas especializadas.

- Desconfía de las respuestas demasiado seguras. A veces la IA se equivoca con una tranquilidad envidiable.

La lección de fondo es simple y valiosa. La IA más confiable no es la que más presume, sino la que está mejor acompañada.

Eso cambia la conversación sobre el futuro. El valor no estará solo en el modelo de moda, sino en los equipos que sepan construir los andamios: procesos, validaciones, herramientas y criterio humano.

En otras palabras, el futuro no pertenece a la máquina que habla bonito. Pertenece a quien sepa hacer que esa máquina trabaje bien.

Compartir nota